Home > ニュースレター バックナンバー > 30号 目次> 技術紹介:バリアフリー・ロボット・インターフェイス CHRIS

技術紹介:バリアフリー・ロボット・インターフェイス CHRIS

柴 建次, 辻 敏夫(広島大学大学院工学研究科)

近年,高齢者や障害者は増加傾向にあり,大学や研究機関などでは生活支援を目的としたバリアフリーロボットの開発が進められている.口元まで食事を持ってきてくれる食事支援ロボット1) や,障害物を回避しながら目的地まで移動する自動操縦機能を備えた電動車椅子2) などもその一つである.しかし,従来から,人がロボットを操作するためのインタフェースには,ジョイスティック,スイッチ,マウスなどが用いられており,身体に重度の障害を持つ操作者の場合,ロボットを自由に操作することは困難であった.誰もが発生している生体信号を計測し,その信号によって操作可能なロボットシステムが構築できれば,身体に障害を有する操作者も,健常者と同じようにロボットを操作することが可能になるのではないだろうか.

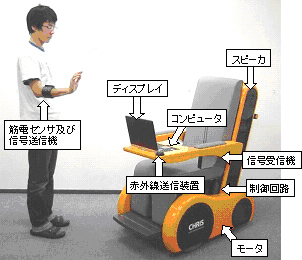

そこで,我々は,ロボットを動かすためのインタフェースとして,生体信号を使ったロボットインタフェース CHRIS (Cybernetic Human-Robot Interface System)を提案している.そして,これまで,CHRISによる食事支援ロボット,家電製品,携帯電話,ゲームマシンなどの遠隔操作を実現してきたが,2005年にはCHRISを組み込んだ車椅子タイプのロボットを開発した(図1参照).本稿ではその概要について述べる.

2. CHRISロボットの操作信号として生体信号を用いる場合,操作する人や計測部位よって発生する信号の特性が大きく異なる.しかし,CHRISは操作者一人一人の生体信号や身体特性の特徴を捉え,自らが学習し,操作者に合わせてくれるインタフェースシステムである.このシステムではLog-Linearized Gaussian Mixture Network 3-6)というニューラルネットを用いた学習アルゴリズムを搭載することでこれを可能としている.このアルゴリズムは,高精度かつ高速な学習が可能で,学習により操作者の個人差を吸収することができるので,操作がはじめての人や体の一部しか動かすことができない人でも容易に操作することが可能となる.

次に,このCHRISを搭載したロボットの一例を紹介する.図2は,生体信号のひとつである筋電信号により操作可能な車椅子型ロボットである.操作者の体には,筋電を読み取るバンド状のセンサを装着し,ここから筋電信号を計測する.計測された筋電波形データはリアルタイムでCHRIS本体に無線伝送される.CHRISには,コンピュータが搭載されており,採取した筋電データから操作意図の抽出を行う.例えば,センサをつけた側の手首を上に曲げれば前進,下に下げれば後退,右に曲げれば右回転,左に曲げれば左回転と割り当てておけば,コンピュータは筋電波形からそれらを見分け,ほぼ100%の成功率で操作意図を抽出する.手に限らず,センサを顔につければ,左右の目の動きや瞬き等から操作意図を抽出することも可能である.図3(動画)は,車椅子型ロボットを遠隔操作しているところであり,操作者が手首を上下左右に曲げることでロボットを操作している様子を示している.また,センサ部とロボットは無線通信網で接続されていることから,離れていても操作することができる.図4は乗車せずに遠隔で操作している様子である.このとき,操作者は手元のディスプレイ上(図4左下)に表示される「前進」,「後退」,「右回転」,「左回転」,「停止」のメニューコマンド(図4右下の枠内参照)を選択することで操作することができる.

<図1> CHRISの概要

<図2> 遠隔操作中のCHRIS

<図3> CHRISの搭乗操作(動画)

<図4> CHRISの遠隔操作(動画)

また,このロボットには全方向性赤外線送信装置,小型カメラ,マイク,スピーカを搭載しており,移動機能の他に,電化製品の制御やテレビ電話によるコミュニケーションも可能である.これらの操作は,図5のディスプレイに表示されるメニュー画面を見ながらおこなう.図5のディスプレイには,例として4つの家電製品の画像が表示されているが,手首を上下左右させることによって,そのうちの一つを選択(色反転)することが可能である.選択したい画面の上で,右手を握れば決定が実行され,次のメニュー画面が表れる.最後に希望のコマンドの上で決定を実行すれば,赤外線送信装置から赤外線制御信号が送信され,家電製品を操作することができる. 家電製品の操作の様子を図6に示す.

<図5> 家電製品の操作画面

<図6> 家電製品の制御の様子

3. 愛知万博の会場にて

2005年6月,CHRISを用いたロボットを愛知万博に出展した.図7,8はそのときの様子である.テレビ局の女性アナウンサや,小学生,60歳をすぎた男性等,数名の一般来場者に操作を体験して頂いた.どの体験者も,すぐにロボットを操作でき,CHRISの学習能力の高さが明らかになった.

また,交通事故により首から下が麻痺した頚椎損傷患者にも,後日,操作を体験して頂いた.センサは左右の頬に付け,頬の筋肉を動かすことでロボット操作を試みたところ,スムーズに操作することが可能であり,障害者を対象とした福祉機器としての有用性を確認することができた.

<図7> 万博会場にて

<図8> 家電操作中の車椅子型ロボット

筋電信号により操作可能な車椅子型ロボットを試作し,評価した.今後このようなシステムが量産可能となれば,バリアフリーロボットが家庭内に普及する日も,決して遠くないであろう.

5. 参考文献 1) セコム(株) http://www.secom.co.jp/

2) 次世代インテリジェント車椅子ロボット「TAO Aicle」(タオアイクル) http://www.nedo.go.jp/expo2005/robot/work/page008.html

3) T.Tsuji, O.Fukuda, H.Ichinobe and M.Kaneko, A Log-Linearized Gaussian Mixture Network and Its Application to EEG Pattern Classification, IEEE Transactions on Systems, Man, and Cybernetics-Part C, Vol. 29, No. 1, pp.60-72, February, 1999.

4) T. Tsuji, N. Bu, M. Kaneko, and O. Fukuda, “A Recurrent Log- Linearized Gaussian Mixture Network,” IEEE Transactions on Neural Networks, Vol. 14, No. 2, pp. 304-316, 2003.

5) O. Fukuda, T. Tsuji, M. Kaneko and A. Otsuka, “A Human-Assisting Manipulator Teleoperated by EMG Signals and Arm Motions, ” IEEE Transactions on Robotics and Automation, Vol. 19, No. 2, pp. 210-222, 2003.

6) K. Shima, N. Bu, M. Okamoto, and T. Tsuji, “A Universal Interface for Video Game Machines Using Biological Signals,” Proceedings of 4th International Conference on Entertainment Computing ?ICEC 2005, pp. 88-98, 2005.